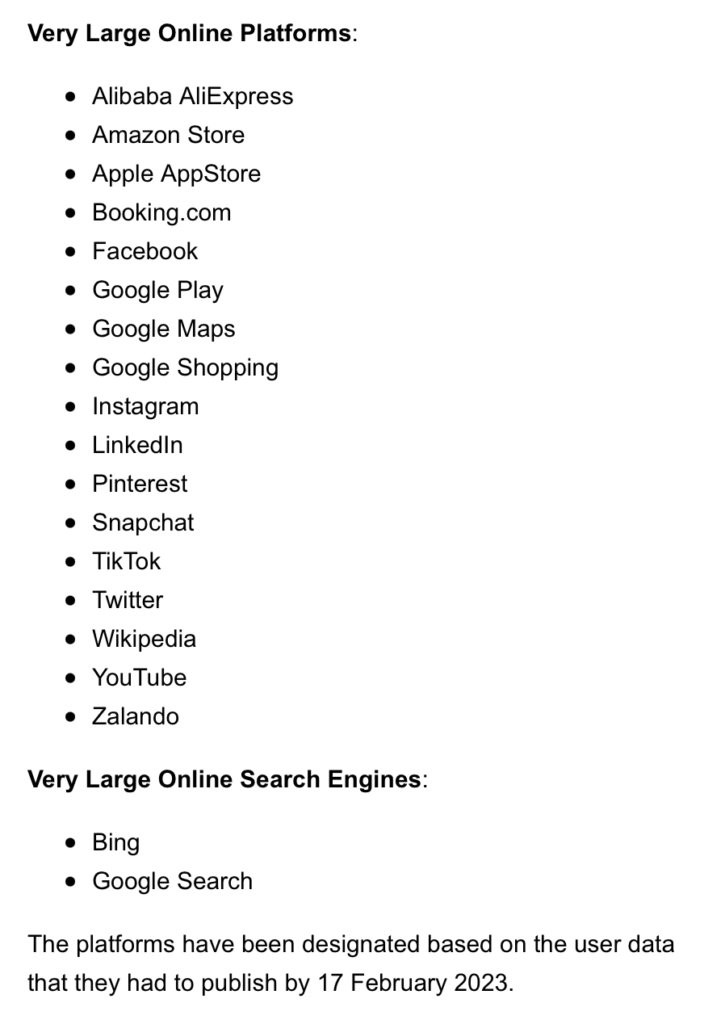

La Commission européenne a adopté le 16 novembre 2022 le Digital Services Act (DSA) pour créer un environnement numérique plus sûr et établir des conditions de concurrence équitables pour stimuler l’innovation, la croissance et la concurrence sur les marchés européens et mondiaux. Les premiers destinataires désignés sont 19 grandes plateformes technologiques, dont 17 grandes plateformes en ligne et 2 grands moteurs de recherche. Les entreprises désignées ont 4 mois pour se conformer aux nouvelles obligations de protection des utilisateurs en ligne énoncées dans le DSA.

Les entreprises désignées doivent renforcer les autorisations des utilisateurs, améliorer la protection des mineurs, renforcer la modération et réduire la désinformation. Les grandes plateformes en ligne désignées comprennent AliExpress, Amazon, l’App Store (Apple), Booking.com, Facebook, Google Play, Google Maps, Google Shopping, Instagram, LinkedIn, Pinterest, Snapchat, TikTok, Twitter, Wikipedia, YouTube et Zalando. Les grands moteurs de recherche désignés sont Bing et Google Search.

Les entreprises désignées doivent se conformer aux nouvelles obligations de protection des utilisateurs en ligne énoncées dans le DSA. Les obligations comprennent le renforcement des autorisations des utilisateurs, la protection des mineurs, la modération et la réduction de la désinformation. Les grandes plateformes en ligne désignées doivent également fournir des informations claires aux utilisateurs sur les raisons pour lesquelles certaines informations sont recommandées et leur donner le droit de se désinscrire des systèmes de recommandation basés sur le profilage.

Les utilisateurs doivent de leur côté pouvoir être en mesure de signaler facilement les contenus illégaux, et les plateformes doivent traiter ces signalements avec soin. Les plateformes ne peuvent pas afficher de publicités basées sur les données confidentielles des utilisateurs, telles que l’origine ethnique, les opinions politiques ou l’orientation sexuelle. Les plateformes doivent étiqueter toutes les publicités et informer les utilisateurs de qui fait la publicité. Les plateformes doivent également fournir un résumé facilement compréhensible des conditions d’utilisation dans la langue du pays membre où elles opèrent.

Les grandes plateformes en ligne désignées doivent également améliorer la protection des mineurs en garantissant une sécurité et une confidentialité accrues. Les publicités ciblées basées sur le profilage des enfants ne sont plus autorisées. Les plateformes doivent également fournir une évaluation des risques spéciaux, y compris les risques pour la santé mentale, qui doit être soumise à la Commission 4 mois après la désignation et publiée au plus tard 1 an après la désignation. Les plateformes doivent également repenser leurs interfaces, leurs systèmes de recommandation et leurs conditions d’utilisation pour atténuer ces risques.

Les grandes plateformes en ligne désignées doivent également renforcer la modération et réduire la désinformation. Les plateformes et les moteurs de recherche doivent prendre des mesures pour lutter contre la diffusion de contenus illégaux en ligne et les risques pour la liberté d’expression et la liberté de la presse. Les plateformes doivent appliquer leurs conditions d’utilisation de manière honnête et non arbitraire. Les plateformes doivent également fournir un mécanisme permettant aux utilisateurs de signaler rapidement les contenus illégaux. Les plateformes doivent analyser les risques spécifiques et mettre en place des mesures d’atténuation pour lutter contre la désinformation et l’utilisation abusive des services.

Les grandes plateformes en ligne désignées doivent également améliorer la transparence et la responsabilité. Les plateformes doivent garantir que leur conformité aux évaluations des risques et à toutes les obligations du DSA est vérifiée de manière indépendante. Les plateformes doivent fournir un accès aux données publiques pour les chercheurs. Les plateformes doivent également publier un référentiel de toutes les publicités diffusées sur leur interface. Les plateformes doivent publier des rapports de transparence sur les décisions de modération de contenu et la gestion des risques.

Commentaires